Un viaje al interior de la empresa que busca revolucionar la robótica con IA

Las habilidades lingüísticas de la inteligencia artificial comenzaron a cambiar en 2018, cuando OpenAI demostró que un modelo de aprendizaje automático, conocido como 'transformer', podía generar trozos de texto sorprendentemente coherentes cuando se le daba una cadena inicial. Los informáticos habían pasado décadas tratando de escribir programas para manejar el lenguaje en toda su complejidad y ambigüedad. El modelo de OpenAI se conoce como Generative Pretrained Transformer (Transformador Generativo Preentrenado) o, de cariño, GPT. Mejoró constantemente a medida que se le alimentaba con cantidades cada vez mayores de datos extraídos de libros e internet (¿con el permiso de quién?), hasta que llegó a ser capaz de mantener conversaciones convincentes y responder a una amplia gama de preguntas.

Robots con un plan. ¿Qué puede salir mal?

A principios de 2022, Hausman e Ichter, entonces en Google, junto con Levine, Finn y otros, demostraron que los LLM también podían ser la base de la inteligencia robótica. Aunque los LLM no pueden interactuar con el mundo físico, contienen mucha información sobre objetos y escenas gracias al vasto alcance de sus datos de entrenamiento. Aunque imperfecto (como alguien que entiende el mundo simplemente leyendo sobre él), ese nivel de comprensión puede bastar para dotar a los robots de la capacidad de idear planes de acción sencillos.

Hausman y compañía conectaron un LLM a un robot manco en un simulacro de cocina en la sede de Google en Mountain View (California), dándole la capacidad de resolver problemas abiertos. Cuando al robot se le decía: "Se me cayó la Coca-Cola en la mesa", utilizaba el LLM para idear un plan de acción sensato que incluía encontrar y recuperar la lata, tirarla a la basura y conseguir una esponja para limpiarla, todo ello sin programación convencional.

Más tarde, el equipo conectó al mismo robot un modelo de lenguaje visual, entrenado tanto con texto como con imágenes, para mejorar su capacidad de entender el mundo que le rodea. En un experimento, colocaron cerca fotos de distintos famosos y pidieron al robot que le diera una lata de refresco a Taylor Swift: "Taylor no aparecía en ninguno de los datos de entrenamiento del robot, pero los modelos de visión del lenguaje saben cómo es", explica Finn, con su largo pelo castaño enmarcando una amplia sonrisa.

Ese mismo año, justo cuando ChatGPT se estaba haciendo viral, el equipo decidió hacer una demostración del robot en una conferencia académica en Auckland, Nueva Zelanda. Ofrecieron a los asistentes la posibilidad de controlarlo en California tecleando las órdenes que quisieran. El público quedó impresionado por la capacidad general del robot para resolver problemas, pero también creció el interés por las implicaciones más amplias de ChatGPT.

Los LLM pueden ayudar a los robots a comunicarse, reconocer cosas y elaborar planes, pero su capacidad más básica para actuar se ve limitada por la falta de inteligencia sobre el mundo físico. Saber cómo agarrar un objeto de forma extraña es trivial para los humanos solo gracias a una profunda comprensión instintiva de cómo se comportan las cosas tridimensionales y cómo funcionan nuestras manos y dedos. Los expertos en robótica reunidos se dieron cuenta de que las extraordinarias habilidades de ChatGPT podrían traducirse en algo igual de impresionante en las habilidades físicas de un robot, si se pudieran captar a gran escala las acciones en lugar de las palabras y aprender de ellas. "Había una energía en el aire", recuerda Finn.

Ha habido indicios de que esto puede funcionar

En 2023, Quan Vuong, otro cofundador de Physical Intelligence, reunió a investigadores de 21 instituciones diferentes para entrenar 22 brazos robóticos distintos en una serie de tareas utilizando el mismo modelo de transformer. En la mayoría de los casos, el nuevo modelo era mejor que el que los investigadores habían desarrollado específicamente para su robot", recuerda Finn.

Fotografía: Will Knight

Del mismo modo que los humanos aprenden durante toda su vida a pasar de tantear objetos en la primera infancia a tocar el piano unos años más tarde, alimentar a los robots con muchos más datos de entrenamiento podría revelar nuevas habilidades extraordinarias.

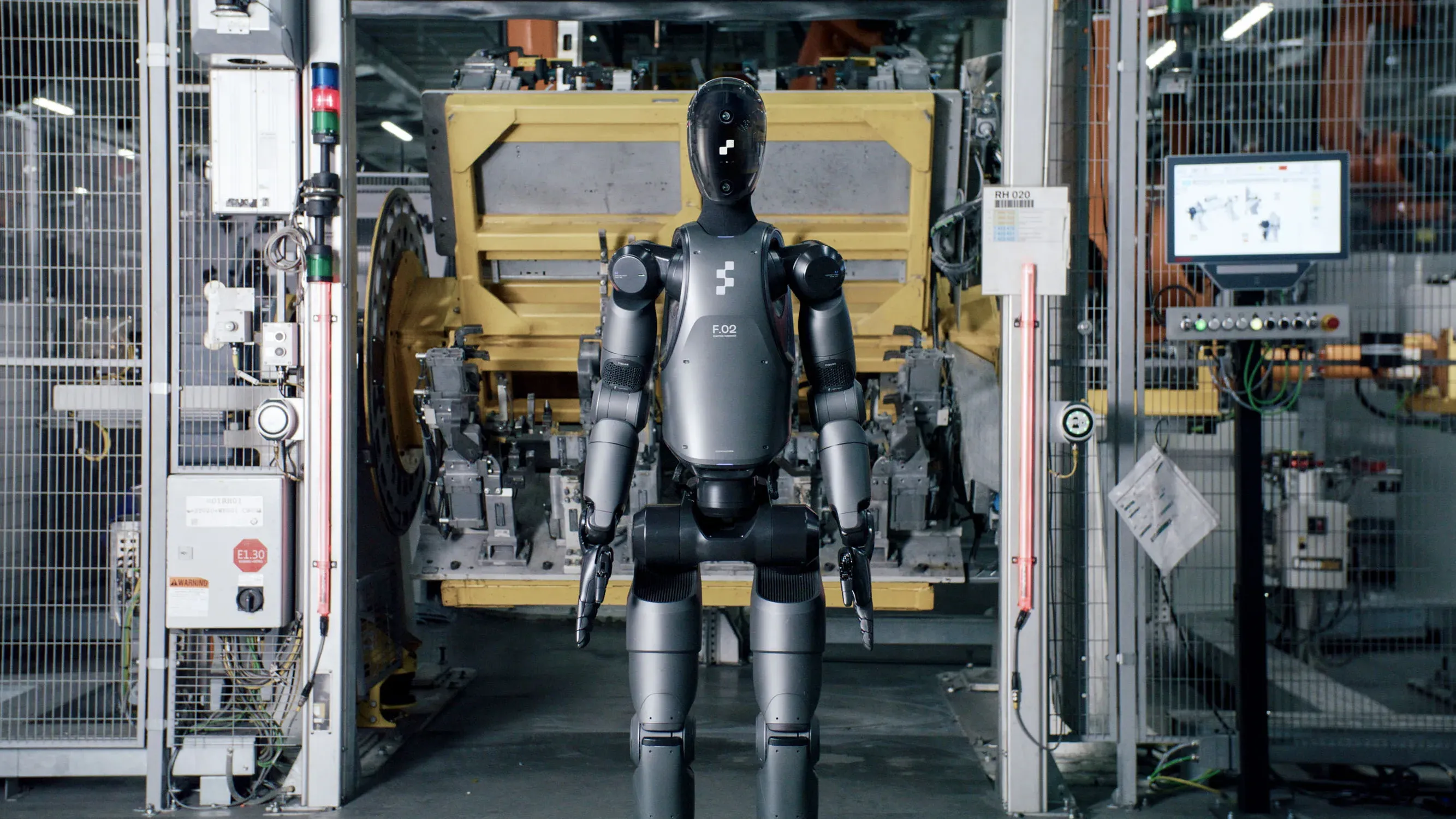

Las expectativas de una revolución robótica también se ven avivadas por los numerosos robots humanoides que están promocionando empresas emergentes como Agility y Figure, así como grandes compañías como Hyundai y Tesla. Las capacidades de estas máquinas siguen siendo limitadas, pero las demostraciones teledirigidas pueden hacer que parezcan más capaces, y sus defensores prometen grandes cosas. Hace poco, Elon Musk llegó a sugerir que los robots humanoides podrían superar en número a los seres humanos en la Tierra en 2040.

Source link

Share this content: